深圳先进院针对肺部CT影像提出一种基于聚焦-融合-修正的深度网络架构

近日,中国科学院深圳先进技术研究院数字所生物医学信息技术研究中心李烨研究员团队与中国人民解放军总医院团队合作,针对肺部CT影像提出了一种基于聚焦-融合-修正的上下文学习深度神经网络,实现了新冠肺炎(COVID-19)肺部感染病变的自动识别与分割,有效提升了计算机断层扫描(CT)影像中病变区域的自动分析与识别准确率。该成果已发表在计算机人工智能期刊IEEE Transactions on Neural Networks and Learning Systems上。

通过人工智能算法从CT图像中自动检测和识别COVID-19肺部感染,可以为病人诊断、治疗以及预后监测提供一种快速且有效的计算机辅助诊断方法,同时可以有效缓解专业放射科及临床医生短缺问题,为及时快速筛查和分级诊断提供辅助影像学证据。然而,从二维CT图像中分割感染区域面临着诸多挑战,其中包括感染区域特征的高度变化以及感染与正常组织之间的对比度低、边缘模糊等问题。

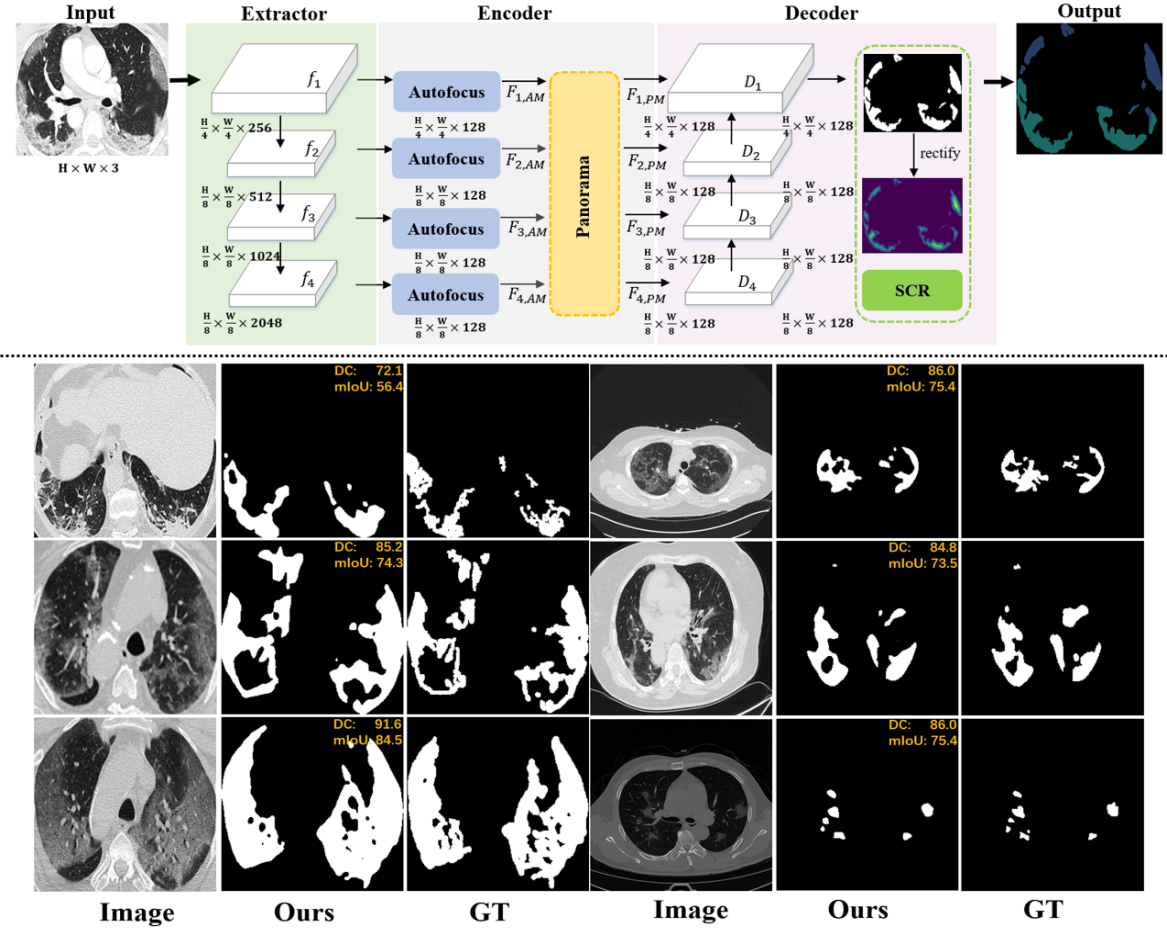

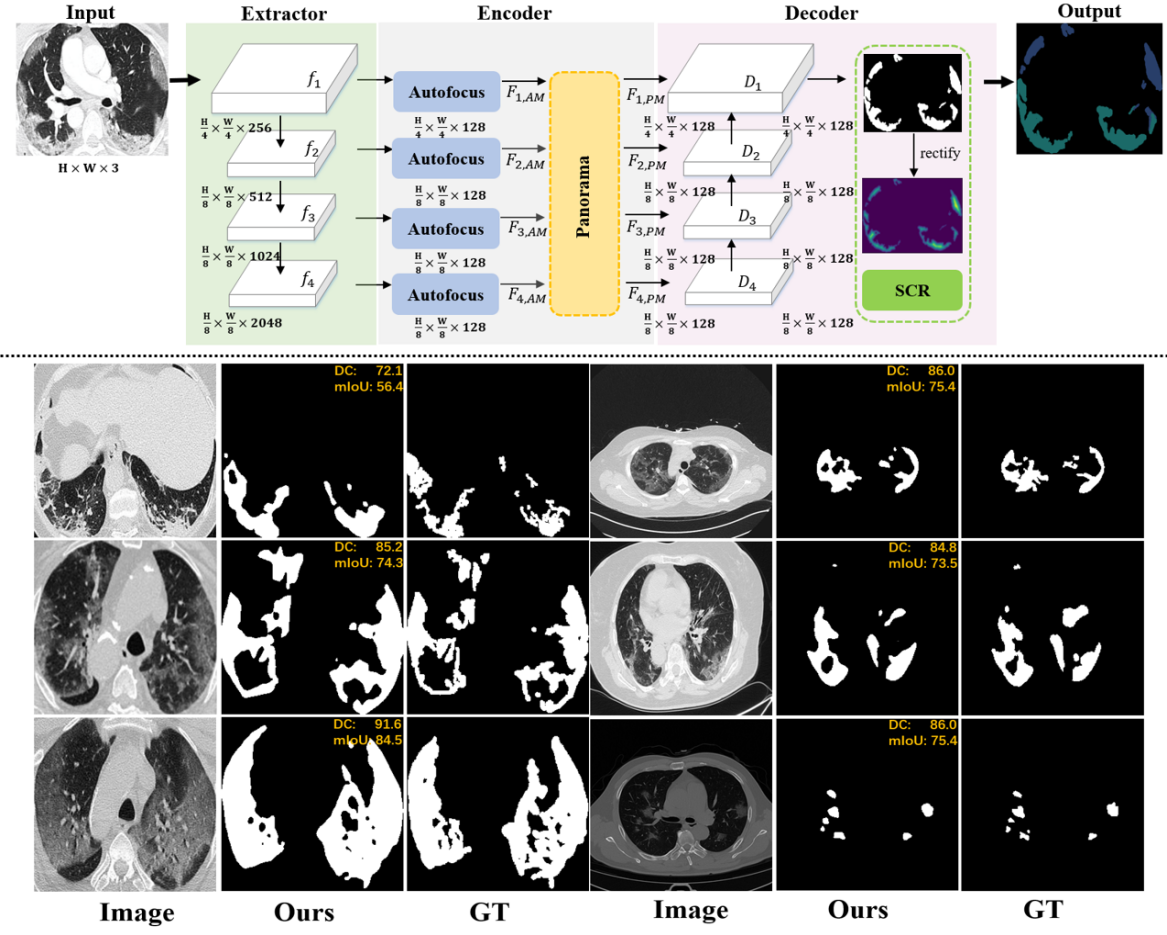

针对上述问题,团队提出了一种基于聚焦-融合-修正的深度网络架构,通过设计的自动聚焦和全景聚合模块自适应的、整合了网络同级和跨层级的上下文信息,有效缓解了由于病变分布散乱、形状不规则等造成的识别精度低问题。进一步,网络架构中引入结构一致性修正机制,在学习过程中利用距离映射对每个像素及其周围区域进行编码,有效将区域的结构信息引入学习过程,提高了模型对复杂病变结构的感知,降低了其它信息的干扰。在新冠肺炎CT影像分割应用中,分割效果超过近期提出的多种深度学习方法。

该研究工作得到中科院战略性先导科技专项(B类)、深圳市科创委“新型冠状病毒感染应急防治”专项以及国家自然科学基金等的资助。

基于聚焦-融合-修正的上下文学习网络示意图